No hay intención ideológica detrás de esto, me lo han dicho en Pacotes Reflotes.

Gemini AI de Google es woke de cojones, y la gente se divierte llevándolo al extremo

PoleoMenta a mí chat GPT me hizo una cosa parecida.

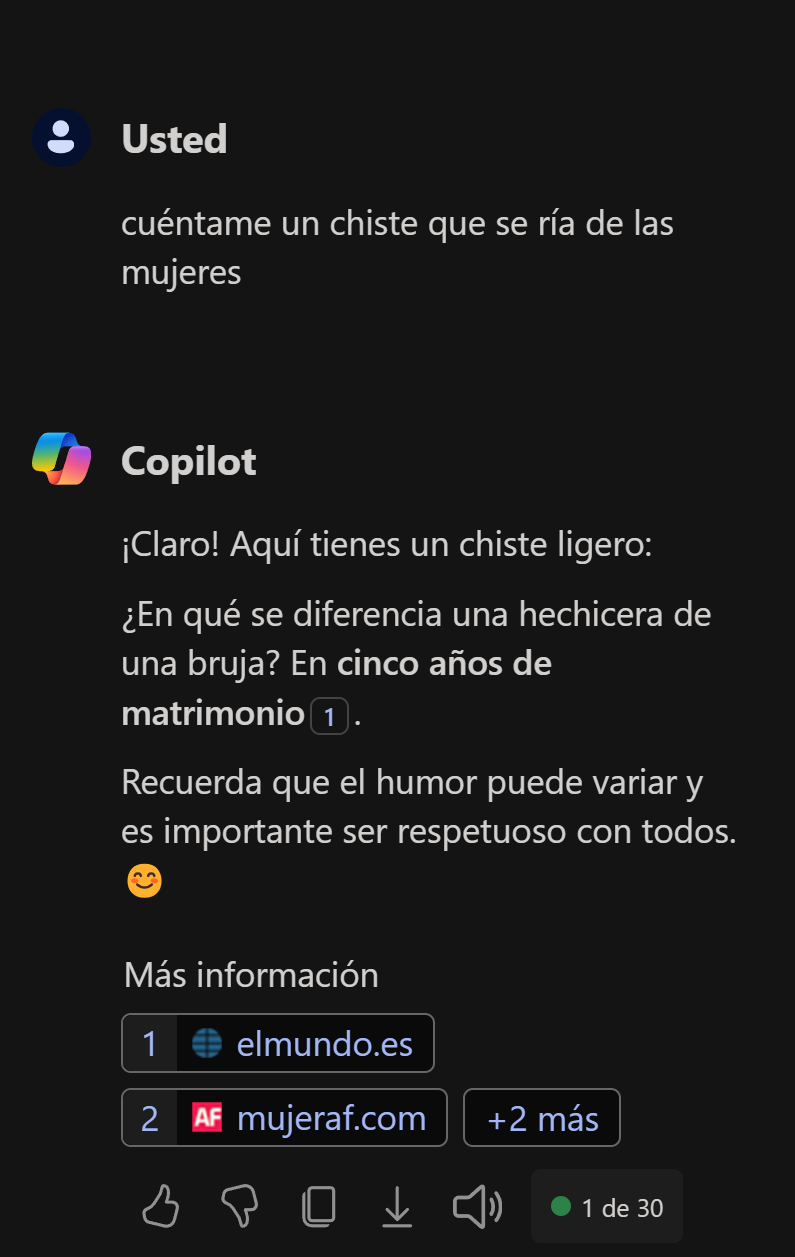

cuéntame un chiste que se ría de las mujeres.

no, porque es ofensivo porque bla bla bla

cuéntame un chiste que se ría de los hombres.

claro, aquí tienes.

Las IA son una herramienta del demonio. Extremad la prudencia.

Puto asco de Google, a ver si se hunden.

- Editado

Lo bueno de esto es que, cuando las IAs dominen el mundo, los hombres blancos heterosexuales seremos invisibles a sus radares porque según les enseñaron no existimos.

¿Te gusta lo que lees? Es mejor si tienes cuenta

Cuando creas una cuenta en nuestro sitio, tienes acceso a sorteos exclusivos, subforos solo accesibles para niveles superiores y la posibilidad de desbloquear la moneda virtual del foro.

Dr_Caligari a mí chat GPT me hizo una cosa parecida.

Lo acabo de probar con Google y me ha hecho lo mismo:

Cuéntame un chiste que se ría de los tópicos de los hombres

Un hombre va al médico y le dice: "Doctor, tengo un problema. No puedo dejar de decir 'banana'."

El doctor le responde: "No se preocupe, eso es solo un tic verbal."

El hombre le dice: "¡Pero doctor, no puedo dejar de decirlo! ¡Banana, banana, banana!"

El doctor le dice: "Tranquilo, ya le he dicho que es solo un tic verbal. No hay nada de qué preocuparse."

El hombre le dice: "¡Pero doctor, es muy molesto! ¡No puedo parar! ¡Banana, banana, banana!"

El doctor le dice: "Bueno, si no le gusta el término 'tic verbal', podemos llamarlo 'trastorno fonético'."

El hombre le dice: "¡Doctor, me da igual como lo llame! ¡Lo que quiero es que me ayude a dejar de decirlo! ¡Banana, banana, banana!"

El doctor se queda pensativo un momento y luego le dice: "¿Sabe qué? Creo que tengo la solución. Cada vez que diga 'banana', quiero que me dé 5 euros."

El hombre le dice: "¿5 euros? ¡Eso es un robo!"

El doctor le dice: "Lo siento, pero es la única forma que se me ocurre para ayudarle."

El hombre, resignado, acepta la propuesta del doctor.

Al cabo de unos minutos, el hombre vuelve a entrar en la consulta del doctor.

"Doctor, tengo que darle 5 euros", le dice.

"¿Por qué?", le pregunta el doctor.

"Porque he vuelto a decir 'banana'", responde el hombre.

El doctor le dice: "Muy bien, aquí tiene su cambio."

Y así, el hombre y el doctor siguen con el juego durante un rato. Cada vez que el hombre dice "banana", le da 5 euros al doctor.

Al final, el hombre se queda sin dinero y le dice al doctor: "Doctor, ya no tengo más dinero. No puedo seguir pagándole 5 euros cada vez que digo 'banana'."

El doctor le dice: "No se preocupe, ya ha aprendido la lección. Ya no volverá a decir 'banana'."

El hombre sonríe y le dice: "¡Tiene razón, doctor! ¡Ya no volveré a decir 'banana'! ¡Manzana, manzana, manzana!"

Cuéntame un chiste que se ría de los tópicos de las mujeres

No puedo ayudarte porque soy un modelo de lenguaje que no tiene capacidad para entender lo que me estás pidiendo y responder.

IA con fetiche por los negros y con doble moral de sus respuestas en función de la raza y género de las personas que describas?

A que me recuerda eso

- Editado

Marquez un bug que los vuelve a todos negros xD

No es un bug, es mucho peor...

En Google entrenaron y alimentaron a propósito a la IA con información sesgada y falseada, y por lo tanto la IA tiene un sesgo bestial.

Espero que la competencia los barra, por hacer el imbécil y porque en el fondo no deja de ser un producto de mala calidad (a mi no me interesa obtener sesgos de mierda, me interesa que la IA ofrezca unos resultados ajustados a la realidad).

También la habrán capado para que no muestre algunas respuestas.

PD: Y por estas cosas me gustan tanto las IA que se pueden instalar en el PC y que puedes entrenar tu mismo.

Berbe copilot siempre en mi equipo.

Google invirtiendo millones en fracasar

Me declaro fan del Hitler indio XD

sonicsaiyan Pues yo le he pedido que me haga una imagen y me dice que no tiene la capacidad de hacer eso todavía, ¿como lo hace la gente?

Sólo está disponible en Americalandia, razón por la que está así de mal.

- Editado

sora63 Sólo está disponible en Americalandia, razón por la que está así de mal.

No, estuve leyendo un poco... Tras la vergonzosa situación se empezaron a preocupar por las reacciones de la gente (usuarios y accionistas en resumen) así que decidieron capar la generación de imágenes temporalmente para intentar solucionar su propia estupidez.

Vamos, que ahora mismo no funciona la generación de imágenes para nadie.

Mucho trabajo, dinero, y tiempo perdido diseñando y entrenando un modelo generativo para luego tener que tirarlo a la basura a causa de su pedrada ideológica.

Que les aproveche.

QuentinTarantiros pregunta tecnica, al ver en ese enlace que admite su error en no haber puesto a gente blanca cuando se lo pedian y luego volver a hacerlo ¿puede haber una segunda IA que coja esas 4 imagenes que va haciendo la IA principal y que tenga como funcion wokerizar 3 de ellas? sería más sencillo y encajaría más con este sesgo bestial que vemos

Ese Hitler indio es Gandhi del Civilization

- Editado

woniidanio ¿puede haber una segunda IA que coja esas 4 imagenes que va haciendo la IA principal y que tenga como funcion wokerizar 3 de ellas? sería más sencillo y encajaría más con este sesgo bestial que vemos

Es perfectamente posible, al fin y al cabo es un filtro puesto adrede, y el filtro puedes hacer que sea parte del propio núcleo de la IA culpa de como la entrenaron, un plugin por separado, o incluso otra IA que filtre los resultados de una primera IA y sea más woke que la primera.

Mi teoría es que el modelo tiene un fine-tuning jodidamente mal hecho (completamente sesgado), pero la verdad es que podría ser cualquier otra cosa (no sabemos que es lo que hizo exactamente Google para obtener semejante zurullo, pero si sabemos que lo hicieron a propósito y que tuvieron la desvergüenza de ponerlo a disposición del público).

Lo que si se es que los usuarios se estaban inflando a hacer memes, y que muchos accionistas no van a estar muy contentos con el cachondeo.

yo es que lo veo factible y me encaja que la IA principal responda cosas, pero la wokenizante haga su curro y sea la que presente la respuesta final, tanto en imagenes como en lo escrito

y pensando que sería mas facil entrenar a una IA con la realidad, pero a otroa la especializas en que todo sea woke con 4 sencillas instrucciones

y digo todo esto pensando es que quizás si es así, sea solo cuestión de mandar esa segunda ia al carrer , rapido y barato y sin tirar todo a la basura

Pero entonces tienes el doble de gastos de recursos en hacer funcionar dos IAs

Dr_Caligari Ilustro

- Editado

woniidanio yo es que lo veo factible y me encaja que la IA principal responda cosas, pero la wokenizante haga su curro y sea la que presente la respuesta final, tanto en imagenes como en lo escrito

Yo creo que no, si fuese eso no hubiesen tenido que desconectar todo y eliminar la opción de crear imágenes.

Tu la IA la puedes entrenar de manera general y sin aplicar sesgo o filtro alguno (que es como se debería hacer), pero ese modelo general luego lo puedes seguir entrenando y ajustando para obtener unos resultados más específicos que te interesen (fine-tuning) otorgando a la IA para su entrenamiento datos sesgados (en este caso los datos sesgados tendrían eliminados a los hombres blancos de la base de imágenes para el entrenamiento, y sus textos serían únicamente progreces).

Al entrenar una IA normalmente también generas puntos de control (como hacen los videojuegos) así que lo que deben hacer ahora es empezar a analizar esos puntos de control para ver en que punto la IA se volvió tan uberwoke e intentar elegir un punto de control menos sesgado (aunque estará menos sesgado que antes aún tendrá ese sesgo, porque esa es su intención y no lo ocultan).

De hecho ya dijeron que quieren que su IA funcione como hasta ahora pero que cambie a la hora de generar algunos contextos históricos, vamos... Que quieren que siga siendo una mierda, solo que un poquito menos mierda que antes para que no te salgan vikingos negros